— Dell Technologies, Hewlett Packard Enterprise, Lenovo, Meta, Microsoft, Oracle, Supermicro и други обявяват свои платформи с AMD хардуер за високопроизводителни изчислителни среди и генеративни AI приложения —

Санта Клара, Калифорния, САЩ — 6 декември 2023 г. — Днес, AMD (NASDAQ: AMD) обяви пазарния дебют на ускорителите AMD Instinct™ MI300X, с водеща производителност за генеративни AI приложения, машинно обучение и работа с големи езикови модели. Заедно с това компанията пуска AMD Instinct™ MI300A – ускорен процесорен модул (APU), съчетаващ най-новата архитектура AMD CDNA™ 3 и „Zen 4“ CPU за революционна производителност за HPC среди и AI натоварвания.

Сред клиентите, които използват най-новото портфолио от ускорители AMD Instinct, е Microsoft. Компанията наскоро обяви новата серия виртуални машини (VM) Azure ND MI300x v5, оптимизирани за AI работни натоварвания и базирани на ускорители AMD Instinct MI300X. Освен това El Capitan – суперкомпютър с AMD Instinct MI300A APU в Националната лаборатория Лорънс Ливърмор – се очаква да бъде вторият суперкомпютър от екза-ниво, осигуряващ повече от два екзафлопа производителност при изчисления с плаваща запетая с двойна точност, когато инсталацията бъде реализирана докрай. Oracle Cloud Infrastructure (OCI ) планира да добави AMD Instinct MI300X-базирани bare metal инстанции към високопроизводителните изчислителни инстанции за AI на компанията. Базираните на MI300X инстанции се планира да поддържат OCI Supercluster с ултрабърза RDMA мрежа.

Няколко големи ОЕМ производители също демонстрираха ускорени изчислителни системи по време на събитието AMD Advancing AI. Dell показа сървъра Dell PowerEdge XE9680, включващ осем ускорителя AMD Instinct и новия валидиран от Dell дизайн на генеративни AI решения с AMD ROCm-задвижвани AI платформи. HPE наскоро обяви HPE Cray Supercomputing EX255a, първият суперкомпютърен блейд ускорител с AMD Instinct MI300A APU, който ще стане достъпен в началото на 2024 г. Lenovo обяви своята поддръжка на модели с новите ускорители от серия AMD Instinct MI300 с планирана наличност през първата половина на 2024. Supermicro обяви нови допълнения към своето H13 поколение ускорени сървъри с процесори AMD EPYC от 4-то поколение и ускорители от серията AMD Instinct MI300.

AMD Instinct MI300X

Ускорителите AMD Instinct MI300X са изградени по новата архитектура AMD CDNA 3. В сравнение с предишното поколение ускорители AMD Instinct MI250X, MI300X предоставя близо 40% повече изчислителни единици, 1,5 пъти повече капацитет на паметта, 1,7 пъти повече пикова теоретична пропускателна способност при работа с паметта, както и поддръжка за нови математически формати като FP8 и разпределеност; всички насочени към AI и HPC работни натоварвания.

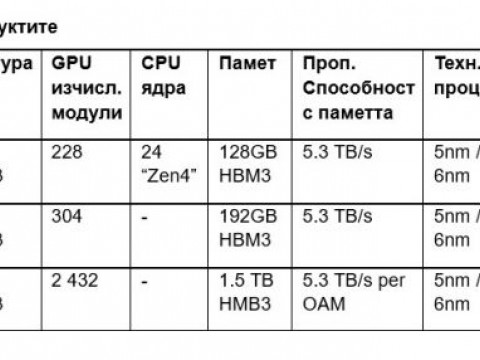

Днешните големи езикови модели (LLM) продължават да нарастват по размер и сложност, изисквайки огромни количества памет и изчисления. Ускорителите AMD Instinct MI300X разполагат с най-добрия в класа си 192 GB HBM3 капацитет на паметта, както и 5,3 TB/s пикова пропускателна способност с паметта, за да осигурят производителността, необходима за все по-взискателните AI работни натоварвания. Платформата AMD Instinct е водеща платформа за генеративни AI решения, изградена по стандартния за индустрията OCP дизайн с осем MI300X ускорителя, за да предложи водещ в индустрията 1,5TB капацитет на HBM3паметта. Стандартният дизайн на платформата AMD Instinct позволява на OEM партньорите на компанията да проектират MI300X ускорители в съществуващи предложения за изкуствен интелект и да опростят инсталациите и разработките на сървъри, базирани на AMD Instinct ускорители.

AMD Instinct MI300A

AMD Instinct MI300A е първият в света APU за центрове за данни за HPC и AI решения. При него са реализирани 3D пакетиране и 4-то поколение AMD Infinity архитектура, за да се осигури водеща производителност при критични работни натоварвания. В MI300A APU се съчетават високопроизводителни AMD CDNA™ 3 GPU ядра, най-новите AMD “Zen 4” x86-базирани CPU ядра и 128 GB HBM3 памет от следващо поколение, за да осигурят ~1,9 пъти по-голяма производителност на ват при FP32 изчисления в сравнение с предишното поколение - AMD Instinct MI250X.

Енергийната ефективност е от изключително значение за HPC и AI средите, но тези приложения са свързани с изключително интензивна работа с данни и ресурси. AMD Instinct MI300A APU се възползват от интегрирането на CPU и GPU ядра в един пакет, предоставящ високоефективна платформа, като същевременно осигурява изчислителна производителност за ускоряване на обучението на най-новите AI модели. AMD е водеща в иновациите свързани с енергийната ефективност. Компанията върви към своята цел 30x25 - 30 пъти подобрение на енергийната ефективност в сървърните процесори и ускорителите за AI-обучение и HPC за периода 2020-2025 г.

Предимството на APU означава, че AMD Instinct MI300A APU разполагат с обединени ресурси от памет и кеш. Това е лесно програмируема GPU платформа за високопроизводителни изчисления, бързо AI обучение и впечатляваща енергийна ефективност за за най-взискателните HPC и AI натоварвания.

Развитие на софтуерната платформа ROCm

AMD обяви най-новата отворена софтуерна платформа AMD ROCm™ 6, както и ангажимента на компанията да предостави най-съвременни библиотеки на общността с отворен код, което затвърждава визията на компанията за разработка на AI софтуер с отворен код. Софтуерът ROCm 6 представлява значителен скок напред на софтуерните инструменти на AMD. Освен това ROCm 6 добавя поддръжка за няколко нови ключови функции за генеративен AI, включително FlashAttention, HIPGraph и vLLM. Това поставя AMD в уникална позиция да използва най-широко разпространените софтуерни модели, алгоритми и рамки с отворен код като Hugging Face, PyTorch, TensorFlow и други.

AMD също така продължава да инвестира в софтуерните разработки чрез придобиванията на Nod.AI и Mipsology, както и чрез стратегически екосистемни партньорства като Lamini за работа с големи езикови модели (LLM) за корпоративни клиенти, и MosaicML с използване на AMD ROCm за LLM обучение на AMD Instinct ускорители с нула промени в кода.